FLStudioの使い方 最適なバッファ サイズの設定方法

FLStudio20び使い方を解説します。

今回はバッファサイズの設定方法です。

ケースバイケースで異なるのですが、ImageLineのホームページに記載がありましたので、それを踏まえて説明していきます。

レイテンシーとは

バッファサイズの前に関係が深いレイテンシーについて簡単に書きます。

Wikiから説明文を引用します。

一般的にコンピュータが音信号を出力する場合、音データを一定長のバッファに記録してから、逐次ハードウェアへと出力する。そのため、バッファのサンプル数をサンプリング周波数(ヘルツ)で割った数だけレイテンシ(秒)が生じる。バッファ容量が小さいほどレイテンシも小さくなるが、時間辺りのオーバーヘッドが増し、システムの性能が低い場合には、処理落ちが生じノイズとなってしまうこともある。

また、エフェクタのデジタル信号処理アルゴリズムによっても、レイテンシは発生する。例えば、高速フーリエ変換(FFT)を用いたアルゴリズムでは、窓幅などに応じてレイテンシが発生し、先読み(ルックアヘッド)機能を備えたリミッター/コンプレッサーでは、先読み時間に応じてレイテンシが発生する。また、マルチトラック再生において、レイテンシのあるエフェクタを特定のトラックのみに用いると、同期がずれてしまう。そのため、全トラックのレイテンシを統一して同期するレイテンシ補正機能を持ったシステムもある。

要はバッファサイズを小さくすればレイテンシー(遅れ)は小さくなり、バッファサイズを大きくするとレイテンシー(遅れ)は大きくなります。

ならバッファサイズを最小にすれば良いんじゃないか?と思う人がいるかもしれないので、説明するとバッファを小さくするとその分CPU負荷が上がります。

じゃあバッファサイズを最大にすればCPUを一番効率的に使えるのかというとそうではありません。

一定以上のバッファサイズでCPU負荷は一定になります。

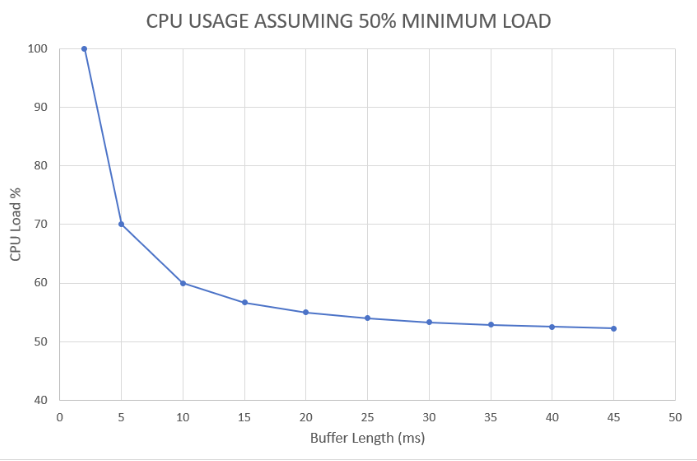

ImageLineから拝借しました。下図からも判る通り、概ねバッファレングスが10ms~25ms位が妥当かと思います。

DTMとして使う場合、12ms(512smp)か24ms(1024smp)の二択になります。レコーディングやライブ演奏などでどうしてもレイテンシーを下げる場合は3ms(128smp)や6ms(256smp)という選択もありだと思いますが、2ms(64smp)は避けた方が良いでしょう。CPUがオーバーロードして起こる事故やノイズの方が危険です。

FLStudioの設定

FLStudioの設定をみていきます。

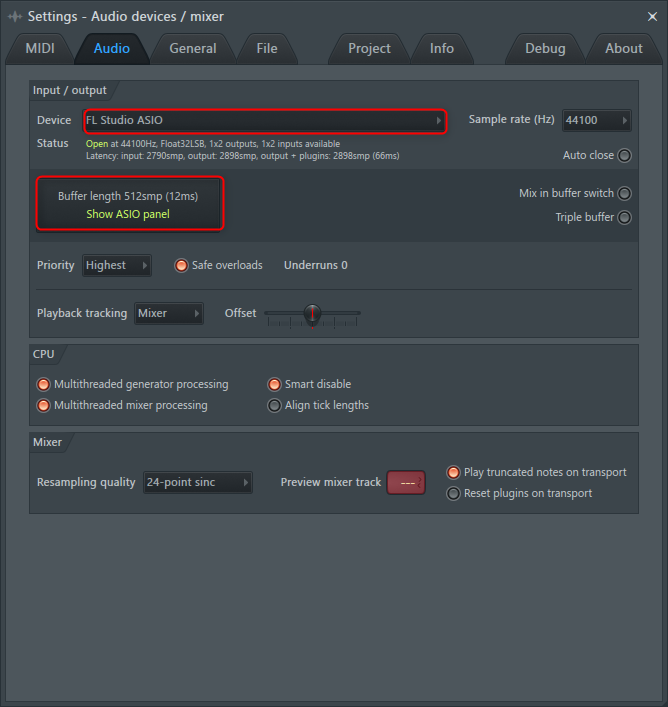

Deviceは使っているオーディオインターフェースのASIOドライバがあればそれを選択。なければFLStudio ASIOを選択します。

右側の「Triple Buffer」はノイズが出ない限りはオフにしておきましょう。バッファが増えるので、レイテンシーも増します。

Buffer length が512smp で12ms位になりますので、512smpが妥当かと思います。

Buffer lengthを変えるには「Show ASIO panel」をクリックします。

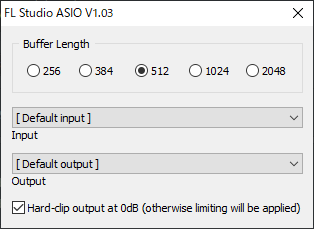

「FL Studio ASIO」の場合は以下のような画面が表示されるので、任意の「Buffer Length」を設定して×ボタンで閉じます。

まとめ

用途によって変更する必要がありますが、

BufferLengthは普通にDTMとして使う場合

12ms(512smp)か24ms(1024smp)

Liveやリアルタイムレコーディングをするような場合は

3ms(128smp)か6ms(256smp)

が最適かと思います。

FLStudioに関する記事は以下にまとめています。

結構大量にありますので良ければ見て行って下さい。

コメント